Η τεχνητή νοημοσύνη τελικά μας απειλεί; Οι εκκλήσεις του Μασκ και ο κίνδυνος για την ανθρωπότητα

Αυτή τη φορά ο Έλον Μασκ δεν... αστειεύεται. Ο ίδιος και χιλιάδες άλλοι ειδικοί θέτουν ζητήματα ασφάλειας για το μέλλον της ανθρωπότητας λόγω της τεχνητής νοημοσύνης. Υπερβάλλουν ή δικαιλογημένα φοβούνται το ChatGPT και τους «συγγενείς» του;

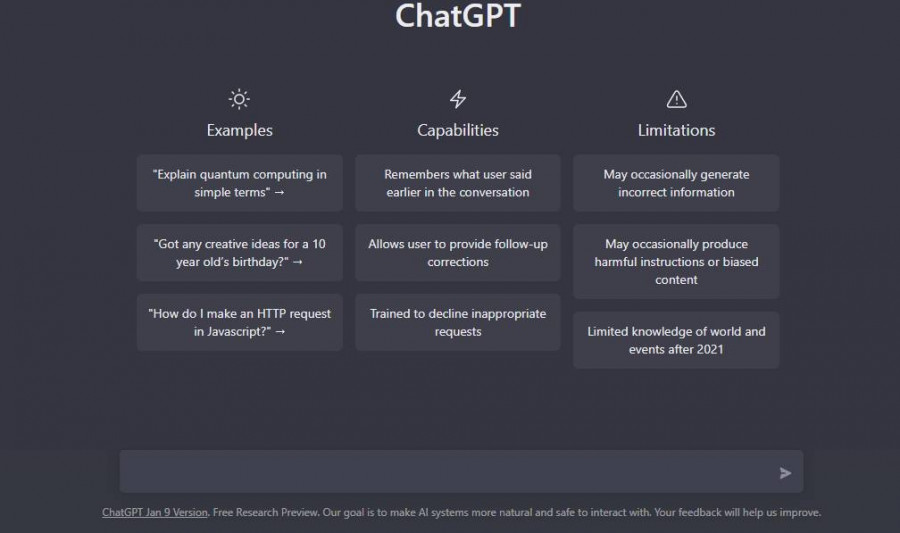

Η έλευση και η διάδοση του πολλά υποσχόμενου ChatGPT 3.5 άνοιξε μια ευρεία συζήτηση σχετικά με το πόση ασφάλεια μπορούμε να νιώθουμε συμβιώνοτας με τα πανίσχυρα εργαλεία της τεχνητής νοημοσύνης.

Ο ενθουσιασμός που δικαιολογημένα προκάλεσε το chatbot της εταιρείας Open AI, όταν κυκλοφόρησε τον περασμένο Νοέμβριο, ταυτόχρονα δημιούργησε και ενός είδους σκεπτικισμό για τις νέες τεχνολογίες και το κατά πόσο η ανθρωπότητα είναι έτοιμη να τις εντάξει στην καθημερινότητά της.

Έξι μήνες μετά, όσοι έχουν αλληλεπιδράσει με το ChatGPT 3.5 κατανοούν πλήρως πως δεν μπορούν να το εμπιστεύονται στο 100% καθώς τα δεδομένα και οι πληροφορίες που μας δίνει ορισμένες φορές δεν ανταποκρίνονται στην πραγματικότητα.

Προκειμένου να διορθώσει τα κακώς κείμενα ο Σαμ Άλτμαν, η ιδιοφυΐα πίσω από την εφαρμογή, παρουσίασε τη βελτιωμένη έκδοση της, το ChatGPT 4 ,το οποίο μεταξύ άλλων έχει τη δυνατότητα να αναλύει και εικόνες.

Φυσικά οι εταιρείες-κολοσσοί από τον τομέα της τεχνολογίας ήταν αδύνατο να παραμείνουν απλοί θεατές των εξελίξεων της εποχής, με την Microsoft να πραγματοποεί «χρυσή» επένδυση στην OpenAI και να ενσωματώνει το ChatGPT στη μηχανή αναζήτησής της. Παράλληλα η Google έφτιαξε το δικό της chatbot, το οποίο ονόμασε Bard και το εκπαίδευσε πάνω σε ένα ασύλληπτα μεγάλο όγκο με δεδομένα για να ξεπεράσει τους ανταγωνιστές της.

Kι ενώ έχει ξεκινήσει αυτή η «κούρσα» ανάμεσα στις δύο εταιρείες αρκετοί είναι αυτοί που χτυπούν «καμπανάκια» ώστε να μην βγει εκτός ελέγχου η κατάσταση και να φτάσουμε να μιλάμε πια για μια απειλή για την ανθρωπότητα. Υπάρχει κάποιος βέβαια που ήδη το έχει κάνει…

Οι εκκλήσεις για μορατόριουμ

Λίγα πρόσωπα απασχολούν την επικαιρότητα με τρόπο όπως ο Έλον Μασκ. Ο ιδρυτής της Tesla και της Space - X πολλές φορές έχει γίνει viral τρολάροντας τους πάντες με τα όσα χιουμοριστικά γράφει και πράττει στα social media.

Αλλά αυτή τη φορά, ο 52χρονος επιχειρηματίας δεν αστειεύεται καθόλου, επισημαίνοντας με τον πιο ξεκάθαρο τρόπο τους κινδύνους που ενέχει η ραγδαία ανάπτυξη της τεχνητής νοημοσύνης.

Ήταν γνωστό ότι ο Μασκ δεν ήταν, ούτε είναι, φανατικός «οπαδός» της τεχνητής νοημοσύνης. Όπως είχε δηλώσει άλλωστε και ο ίδιος το 2017, λόγω του ανταγωνισμού στον συγκεκριμένο τομέα θα ξεσπάσει ο Τρίτος Παγκόσμιος Πόλεμος. Έξι χρόνια μετά, ο δισεκατομμυριούχος μιλά και πάλι για τον μεγάλο κίνδυνο με τον οποίο βρισκόμαστε αντιμέτωποι.

Εν μέσω λοιπόν έντονης ανησυχίας από τον Έλον Μασκ για τις τεχνολογικές εξελίξεις, τόσο ο ίδιος, όσο και ο συνιδρυτής της Apple Στήβεν Βόζνιακ αλλά και χιλιάδες άλλοι ειδικοί-ερευνητές από όλο τον κόσμο δημοσίευσαν μια ανοιχτή επιστολή με την οποία ζητούν μορατόριουμ για την τεχνητή νοημοσύνη.

Πιο συγκεκριμένα ζητούν να «παγώσει» κάθε μορφή εκπαίδευσης σε συστήματα ισχυρότερων από το ChatGPT 4, τα οποία θα μπορούσαν να προκαλέσουν «σοβαρότατους κινδύνους για την κοινωνία και την ανθρωπότητα» εάν δεν διασφαλιστεί επαρκώς η λειτουργία και η εξέλιξή τους.

«Η προηγμένη τεχνητή νοημοσύνη θα μπορούσε να αποτελέσει μια βαθιά αλλαγή στην ιστορία της ζωής στη Γη και θα πρέπει να σχεδιαστεί και να διαχειριστεί με ανάλογη προσοχή και πόρους», τονίζεται στην επιστολή.

Υπογραμμίζεται επίσης, προκαλώντας φόβο, ότι ούτε οι ίδιοι οι δημιουργοί των εν λόγω συστημάτων μπορούν να τα ελέγξουν. «τα εργαστήρια τεχνητής νοημοσύνης έχουν εγκλωβιστεί σε έναν ανεξέλεγκτο αγώνα δρόμου για την ανάπτυξη όλο και πιο ισχυρών ψηφιακών "μυαλών" που κανείς – ούτε καν οι δημιουργοί τους – δεν μπορούν να κατανοήσουν, να προβλέψουν ή να ελέγξουν», αναφέρεται χαρακτηριστικά στην επιστολή.

Το μπουφάν του Πάπα που «κορόιδεψε» το διαδίκτυο

Ο Μασκ και οι υπόλοιποι επιστήμονες ήταν κατηγορηματικοί στα όσα ανέφεραν και περιέγραψαν μια κατάσταση που δικαιολογεί τους φόβους τους.

Πράγματι τα συστήματα ΑΙ πολλές φορές συνοδεύονται από προκαταλήψεις στον προγραμματισμό τους ενώ αν χρησιμοποιηθούν με λανθασμένο και κακόβουλο τρόπο, γίνεται να διασπείρει fake news.

Αλλά ακόμα κι αν δεν υπάρχουν κακές προθέσεις, η τεχνητή νοημοσύνη μπορεί να επιφέρει αντίθετα από τα επιθυμητά αποτελέσματα και να ξεγελάσει τον καθέναν.

Πολύ χαρακτηριστικό και πρόσφατο παράδειγμα ήταν η φωτογραφία που απεικονίζει τον Πάπα Φραγκίσκο να κυκλοφορεί φορώντας ένα μακρύ λευκό μπουφάν. Πολλοί ήταν οι χρήστες του διαδικτύου που νόμιζαν ότι φωτογραφία είναι αληθινή, ωστόσο επρόκειτο για προϊόν της τεχνητής νοημοσύνης.

Σε κάθε περίπτωση προκαλεί προβληματισμό το γεγονός ότι η φωτογραφία ήταν τόσο ρεαλιστική που μπόρεσε να επηρεάσει την ανθρώπινη αντίληψη και κανείς δεν μπορεί να υπολογίσει πόσο αληθινά θα μοιάζουν ανάλογα δημιουργήματα στο μέλλον.

Εξαπλώνεται η ανησυχία

Επιφυλακτικές απέναντι στην εξάπλωση της τεχνητης νοημοσύνης παρουσιάζονται και οι κυβερνήσεις ανά τον κόσμο.

Η Ιταλία έχει ήδη απαγορεύσει προσωρινά το ChatGPT για ζητήματα απορρήτου που προκύπτουν λόγω παραβίασης δεδομένων από την OpenAI, ενώ η κυβέρνηση του Ηνωμένου Βασιλείου δημοσίευσε μια σειρά από ρυθμιστικές συστάσεις την περασμένη εβδομάδα.

Αλλά και η Ευρωπαϊκή Οργάνωση Καταναλωτών κάλεσε τους νομοθέτες σε όλη την Ευρώπη να ενισχύσουν τους σχετικούς κανονισμούς.

Όσον αφορά στις ΗΠΑ, ορισμένα μέλη του Κογκρέσου έχουν ζητήσει νέους νόμους για τη ρύθμιση της τεχνολογίας AI. Τον περασμένο μήνα, η Ομοσπονδιακή Επιτροπή Εμπορίου εξέδωσε οδηγίες για τις επιχειρήσεις που αναπτύσσουν τέτοια chatbot, αφήνοντας να εννοηθεί ότι η ομοσπονδιακή κυβέρνηση παρακολουθεί στενά τα συστήματα AI που μπορούν να χρησιμοποιηθούν από απατεώνες.

Ο αντίλογος του Μπιλ Γκέιτς

Από την άλλη πλευρά, ο ιδρυτής της Microsoft, Μπιλ Γκέιτς, διαμηνύει πως δεν υπάρχει κανένα νόημα στις εκκλήσεις για παύση στην περαιτέρω ανάπτυξη των συστημάτων τεχνητής νοημοσύνης.

«Δεν νομίζω ότι ζητώντας από μια συγκεκριμένη ομάδα να σταματήσει, λύνει τις προκλήσεις», δήλωσε ο δισεκατομμυριούχος επιχειρηματίας πριν από λίγες ημέρες. Συμφώνησε βέβαια ότι θα πρέπει να φωτιστούν ορισμένα «σκοτεινά» σημεία.

Την αντίθεσή του στα ζητήματα ασφαλείας που θέτει η επιστολή, εκφράζει και ο ερευνητής AI, Ρίχαρντ Ζόχερ, λέγοντας ότι ενδεχομένως αν γίνουν γνωστοί οι κίνδυνοι που μπορεί να κρύβει η τεχνητή νοημοσύνη, κάποιοι θα τους εκμεταλλευτούν.

Κάνει μάλιστα λόγο για υπερβολική υστερία γύρω από το θέμα σημειώνοντας ότι οι προτάσεις της ανοιχτής επιστολής είναι «αδύνατο να εφαρμοστούν και αντιμετωπίζει το πρόβλημα σε λάθος επίπεδο», προσθέτει.

Πάντως και οι δύο μεριές φαίνεται ότι συμφωνούν στο γεγονός ότι θα πρέπει να υπάρξουν κάποιες δικλείδες ασφαλείας ώστε να μην επιβεβαιωθούν τα χειρότερα σενάρια και οι προβλέψεις για μια κοινωνία στην οποία οι μηχανές θα υπερτερούν νοητικά έναντι των ανθρώπων.

Διαβάστε επίσης:

- ChatGPT: Είναι ο νέος ψηφιακός σύμβουλος υγείας;

- Ποιος είναι ο δημιουργός της εφαρμογής CHATGPT

- ChatGPT: Η πιο «ανθρώπινη» μηχανή κρύβει παγίδες - Expert της Microsoft εξηγεί τι να προσέχουμε

- ChatGPT: Ένα «τρομακτικό» πολυεργαλείο που θέλει να αλλάξει το Ίντερνετ - Μπορεί;

Δείτε όλο το Weekend Edition εδώ